Nachhaltigkeit und Gemeinwohl

„Das Bild von KI als Werkzeug greift viel zu kurz“

Theresa Züger im Interview mit Jörg Döbereiner

Sie haben eine Methode entwickelt, die helfen soll, zu beurteilen, ob ein bestimmtes KI-Projekt unterm Strich eher nützt oder schadet. Welche Kriterien sind hier aus Ihrer Sicht sinnvoll?

Unsere Kriterien basieren auf den universellen Menschenrechten und den UN-Zielen für nachhaltige Entwicklung (SDGs). Daneben orientieren wir uns auch an anderen Standards, zum Beispiel am AI Act der Europäischen Union, einem der weltweit umfassendsten KI-Gesetze. Im Vordergrund stehen die Auswirkungen von KI-Anwendungen auf Gemeinwohl und Nachhaltigkeit, beides gut ausgehandelte gesellschaftliche Begriffe. Wir stellen uns die Frage: Wenn ein KI-Projekt ein bestimmtes Ziel hat, das im Sinne der Nachhaltigkeit ist – erreicht es dieses Ziel auch? Welche negativen Effekte entstehen dabei möglicherweise? Um das zu beurteilen, betrachten wir mit unserer Audit-Methode verschiedene Dimensionen von Nachhaltigkeit, zum Beispiel soziale, ökonomische und ökologische Aspekte.

Bevor wir genauer auf Ihre Methode eingehen, lassen Sie uns auf den Kontext blicken: Inwiefern hilft KI bereits jetzt dabei, Nachhaltigkeit und Gemeinwohl zu fördern?

Mir ist zunächst wichtig zu klären, was wir überhaupt unter „KI“ verstehen. Grob lässt sich unterscheiden zwischen generativen und nicht-generativen Machine-Learning-Modellen. Generative KI erstellt auf Basis von Deep Learning und als Antwort auf textuelle Anweisungen – sogenannte Prompts – neue Inhalte wie Texte, Videos oder Programmiercode. Dazu zählen beliebte Chatbots wie etwa ChatGPT, Claude oder Gemini. Schon lange zuvor gab es aber nicht-generative Modelle, etwa zur Erkennung von Mustern. Diese benötigen in der Regel kleinere Datenmengen als generative KI.

Insbesondere nicht-generative Modelle kommen bereits in zahlreichen Projekten zum Einsatz, die das Ziel haben, zu mehr Nachhaltigkeit und Gemeinwohl beizutragen. Sie helfen zum Beispiel bei der Erforschung von Biodiversität, indem sie Tiere beobachten und Daten mit Mustererkennung auswerten. Oder sie analysieren Satellitenbilder, um Aufforstung zu verbessern. Andere Anwendungen sollen helfen, klimaschädliche Emissionen einzusparen, zum Beispiel in der Gebäudeklimatisierung oder bei der Optimierung industrieller Prozesse.

Wie stark die positive Wirkung von KI in diesen Feldern global betrachtet ist, lässt sich allerdings schwer beantworten, auch wegen des sogenannten Rebound-Effekts. Das sind Veränderungen, die einen erzielten Einsparungserfolg wieder zunichtemachen. Wenn zum Beispiel ein Unternehmen an einer Stelle mithilfe von KI-Systemen Ressourcen einspart, dafür aber an anderer Stelle expandiert und mehr Ressourcen verbraucht, bleibt netto keine Ersparnis übrig. Solche Effekte lassen sich aber erst nachträglich feststellen, im Rahmen einer umfassenderen Betrachtung.

Solche Rebound-Effekte kann man aber kaum der KI anlasten.

Das stimmt. Aber KI selbst kann man ohnehin nie etwas anrechnen. Es ist immer eine menschliche Entscheidung, ein KI-System zu einem bestimmten Zweck einzusetzen, etwa um Ressourcen zu sparen. Wichtig ist, über kurzfristige Einsparungen hinauszublicken. Leider hat sich bisher bei vielen Aspekten der Digitalisierung gezeigt: Einsparungen sind zwar möglich, sie führen aber unterm Strich oft nicht dazu, dass unsere Wirtschaft weniger Ressourcen verbraucht. Hinzu kommt: Viele Aussagen, die Big-Tech-Unternehmen dazu machen, wie KI für eine nachhaltige Transformation eingesetzt werden kann, sind wenig evidenzbasiert. Unterm Strich kann KI also zwar positive Effekte haben, aber diese lassen sich nur für einzelne Projekte beurteilen und nicht einfach gesamtgesellschaftlich für alle KI-Systeme.

Zu den klar negativen Auswirkungen von KI auf das Gemeinwohl gehört ihr Einsatz im Dienst von Desinformation, etwa zur Manipulation von Bildern und Videos. Sie schreiben aber, dass KI selbst dann problematische Aspekte hat, wenn sie für vermeintlich „gute“ Zwecke eingesetzt wird. Was meinen Sie damit?

Dieser Punkt stellt nicht infrage, dass KI-Systeme in bestimmten Szenarien positive gesellschaftliche Effekte haben können. Es geht vielmehr um grundlegende Dilemmata, die derzeit mit der Industrie um generative KI verbunden sind. Gerade generative KI hat tendenziell einen hohen Verbrauch an Ressourcen, von Energie über Wasser und Mineralien bis hin zur Entsorgung als E-Waste. Viele Data Worker, die KI trainieren und Content moderieren, werden schlecht bezahlt, arbeiten in sehr unsicheren Arbeitsverhältnissen und leiden unter massiven psychischen Belastungen. Weitere wichtige Fragen betreffen die globale Gerechtigkeit: Welche Nationen und Industrien profitieren am meisten von KI? Wer leidet eher unter Ressourcenabbau und schlechten Arbeitsbedingungen? Einige Forschende sprechen bereits von neuen Formen des Kolonialismus.

Wie sind hier Vor- und Nachteile verteilt?

Es leidet eher die „Global majority“: Menschen mit afrikanischen, asiatischen, lateinamerikanischen oder gemischten Hintergründen, welche die Mehrheit der Weltbevölkerung darstellen. Ärmere Länder, in denen viele der Data Worker leben, die aber selbst keine große KI-Industrie beherbergen, sind tendenziell benachteiligt. Dagegen profitieren die westlichen Nationen und vor allem die USA von den günstigen Arbeitskräften in diesen Ländern, vom dortigen Ressourcenabbau und vom Export von E-Waste in diese Länder.

Es muss uns auch klar sein, dass hinter der KI-Industrie sehr mächtige Menschen stehen – insbesondere in den USA –, die antidemokratische Ideologien vorantreiben. Für Elon Musk und andere ist es erklärtes Ziel, staatliche Apparate durch Automatisierung zu ersetzen. Seit Beginn von Donald Trumps zweiter Amtszeit haben wir gesehen, dass dies nicht reine Fiktion ist, sondern ein konkret verfolgtes Szenario.

All das bedeutet nicht unbedingt, dass wir KI nicht nutzen sollten. Aber wir sollten uns dessen bewusst sein, insbesondere wenn wir darüber sprechen, dass wir KI im Sinne des Gemeinwohls einsetzen. Und wir sollten uns überlegen, wie wir diese Bedingungen politisch verändern oder unsere individuelle Nutzung anpassen können.

Ist KI als ein Werkzeug zu betrachten, das man zu verschiedenen Zwecken einsetzen kann, nützlichen wie schädlichen?

Das Bild von KI als Werkzeug greift viel zu kurz. Es verdeckt die hohe Komplexität, die dahintersteht. KI ist ein Sammelbegriff für ganz unterschiedliche Arten von Technologien. Diese sind miteinander verbunden über ein riesiges Netzwerk an materiellen Strukturen, beispielsweise Rechenzentren und die industrielle Infrastruktur, in denen die Data Worker arbeiten. Der Einsatz dieser Technologien geschieht zudem unter sehr schwierigen gesellschaftlichen Grundbedingungen, die uns vor das oben beschriebene Dilemma stellen, wenn wir KI im Sinne von Nachhaltigkeit und Gemeinwohl nutzen möchten.

Das bringt uns zurück zu der von Ihnen entwickelten Audit-Methode zur Beurteilung von KI-Projekten. Wie läuft das ab?

Zunächst identifizieren wir mit unseren Partnern Greenpeace und Gemeinwohl-Ökonomie Deutschland in Frage kommende Projekte und führen Vorgespräche darüber, ob ein Audit stattfinden kann. Es ist wichtig, dass ein KI-System bereits im Einsatz ist, nicht erst in der Forschungsphase. Dann fragen wir Dokumente an und führen Interviews. Uns interessiert beispielsweise, welche Ziele die Projekte verfolgen und wie diese Ziele überprüft werden. Wir werfen aber auch einen Blick auf die technische Infrastruktur und betrachten den ökologischen Fußabdruck.

Insgesamt stellen wir mehr als 200 Fragen, auch solche: Haben Nutzer*innen die Möglichkeit, direkt Kontakt mit einem Projekt aufzunehmen? Können sie Kritik an einem Projekt üben, wenn sie von einer Anwendung betroffen sind und ein Problem sehen? Wie wurden Entscheidungen über das Design des Systems getroffen und auf Basis welcher Argumente? Das geht deutlich tiefer als ein herkömmliches Impact Assessment. Wir möchten den Kontext der Projekte genauer verstehen und haben dafür verschiedene bereits existierende Methoden in unser Modell integriert.

Wie werten Sie die Daten aus?

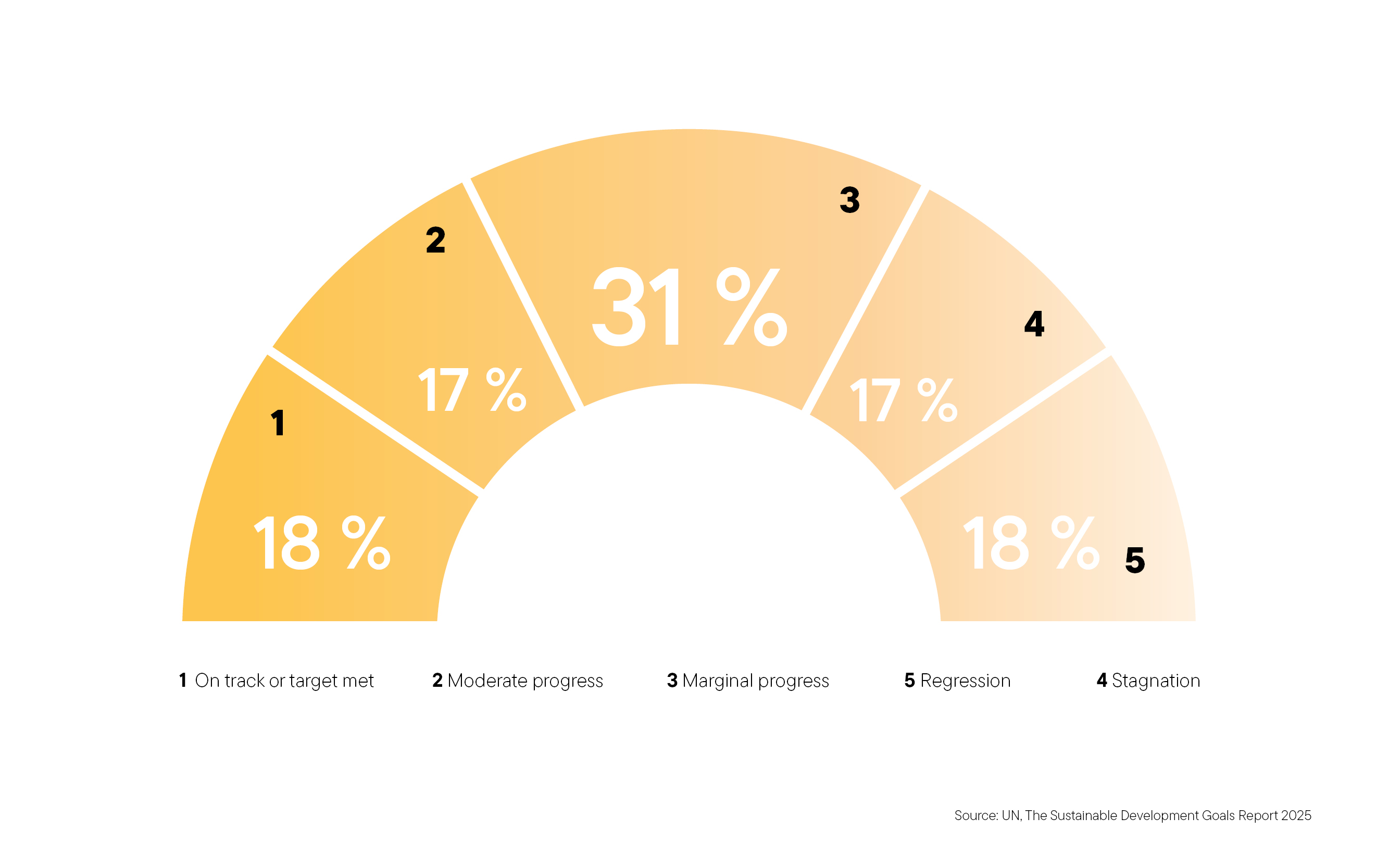

Teils analysieren wir den Inhalt qualitativ, teils werten wir Metriken und Zahlen aus. Dann bewerten wir einzelne Aspekte des Projekts auf einer fünfstufigen Skala. Die Kriterien dafür sind inspiriert von jenen, die die UN für ihre eigenen KI-Projekte definiert hat, den UN Principles for the Ethical Use of AI. Dazu zählt zum Beispiel, ob ein System notwendig und angemessen ist, also ob es nicht einen viel einfacheren Weg gäbe, das besagte Problem zu lösen. Auch andere Aspekte spielen eine Rolle, etwa Sicherheit, Diskriminierung, menschliche Kontrolle, Transparenz und Datenschutz.

An wen richtet sich Ihr Audit?

Wir haben bisher zwei Projekte von etablierten NGOs im Bereich KI und Demokratie auditiert: eines zur Bekämpfung von Desinformation, eines zu demokratischer Meinungsbildung. Demnächst folgt eines im Bereich Digitalisierung der Verwaltung. Bisher haben wir uns auf solche Projekte beschränkt, die den Anspruch haben, zu mehr Nachhaltigkeit und Gemeinwohl beizutragen. Man könnte aber auch andere Projekte mit denselben Kriterien beurteilen.

Erkennen Sie bei führenden KI-Unternehmen ein Interesse, die eigenen Produkte nach solchen Kriterien zu bewerten?

Im Rahmen des globalen Trends zu generativer KI erleben wir eher eine gegenläufige Bewegung: Nachhaltigkeit und Gemeinwohl werden hintenangestellt. Das zeigt sich auch an den Nachhaltigkeitsberichten der Big-Tech-Unternehmen selbst, wo bereits gesetzte Ziele revidiert wurden. Viele der KI-Systeme, die wir im Einsatz sehen, haben ja ganz andere Ziele, als das Gemeinwohl zu fördern. Oft geht es um mehr Konsum und die Platzierung von Werbung, teils aber auch um die Verbreitung von Desinformation. Auch Kontrolle und Überwachung sind zunehmend Einsatzfelder, in denen die KI-Entwicklung den Prinzipien von Gemeinwohl und Nachhaltigkeit entgegenläuft.

Aber gerade wegen dieser Entwicklungen hat Europa die Chance und die Verantwortung, eine andere KI-Vision und ein anderes KI-Ökosystem zu schaffen. Eines, in dessen Zentrum eine alternative Zukunft steht, basierend auf Demokratie und Nachhaltigkeit.

Link

Projekt „Impact AI“ am Alexander von Humboldt Institut für Internet und Gesellschaft

Theresa Züger ist Leiterin des Forschungsschwerpunkts Gesellschaftliche Werte, Transformation und Künstliche Intelligenz am Alexander von Humboldt Institut für Internet und Gesellschaft in Berlin.

zueger@hiig.de