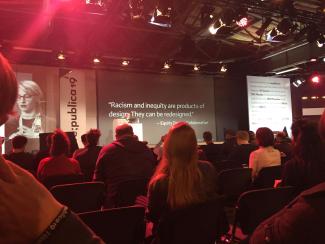

Republica 2019

Mehr Technologie ist keine Lösung

Nur etwas mehr als die Hälfte der Weltbevölkerung hat derzeit Zugang zum Internet. Experten bezweifeln, dass die Weltgemeinschaft das Ziel eines weltweit flächendeckenden Internetzugangs bis 2030 erreichen wird (SDG 9). Der Internetoptimismus vom Anfang der 2000er Jahre ist angesichts einer Vielzahl von Problemen einem nüchterneren Blick auf die Technologie und ihre Chancen gewichen.

Das Internet hat Menschen weltweit vernetzt und gleichzeitig eine neue Arena für die Probleme der analogen Welt geschaffen. In den letzten Jahren wurden im Internet Desinformationen verbreitet, massenhaft persönliche Daten gesammelt, Menschen überwacht, Wahlen manipuliert, Gewalt organisiert, Cyberkrieg geführt und Massenkonsum befeuert, ohne Rücksicht auf die sozialen und ökologischen Folgen zu nehmen.

„Ist das derselbe Raum, mit dem wir die andere Hälfte der Weltbevölkerung verbinden wollen?“, fragte die kenianische Forscherin und Aktivistin Nanjira Sambuli deshalb auf der diesjährigen Digitalkonferenz Republica im Mai in Berlin. In ihrem Vortrag setzte sie sich mit dem Konferenzmotto „tl;dr – too long, didn’t read“ auseinander. Der Internetslang verweist darauf, dass ein Text nicht gelesen wurde, weil er als zu lang erschien.

Für Sambuli steht die Abkürzung für ein tiefgreifendes kulturelles Phänomen. In einer Zeit des Informationsüberflusses ist Aufmerksamkeit eine knappe Ressource. Die individuelle Strategie des tl;dr wird dabei zu einem Bewältigungsmechanismus. „Es würde 70 Stunden dauern, die Geschäftsbedingungen der beliebtesten Internetdienste zu lesen. Wer hat so viel Zeit? Auf der anderen Seite erwarten uns Spaß und unsere Freunde, also stimmen wir zu“, meint Sambuli.

Die Konsequenzen unserer Handlungen holen uns ein. Laut Sambuli ist eine neue Form der Macht entstanden. Große Datensammlungen und Algorithmen ermöglichen Unternehmen, Regierungen und nichtstaatlichen Akteuren neue Wege zur Überwachung, Manipulation und Kontrolle. Da Technologien menschengemacht sind, sind sie anfällig für menschliche Fehler. Dennoch werden sie häufig als fair und objektiv beworben.

Algorithmen sind nicht neutral

In immer mehr Lebensbereichen begegnen wir Algorithmen. Algorithmen sind Schritt-für-Schritt-Anleitungen zur Lösung von Aufgaben und Problemen, die in der Entwicklung von künstlicher Intelligenz und im maschinellen Lernen angewendet werden (siehe Beitrag von Benjamin Kumpf im Schwerpunkt des E+Z/D+C e-Papers 2018/10). Künstliche Intelligenz bedeutet, dass Computer Entscheidungen fällen, die bislang Menschen zustanden. Solche Fähigkeiten können auch dazu dienen, umfangreiche Datensätze auszuwerten und daraus Wissen zu generieren.

Algorithmen verändern die Arbeitswelt. Die kanadische Ethnografin Alex Rosenblat hat den US-Konzern Uber, eine digitale Plattform zur Vermittlung von Fahrdienstleistungen, untersucht. Fahrerinnen und Fahrer arbeiten als selbstständige Dienstleistende und nutzen die App, um Kunden zu gewinnen.

Laut Rosenblat werden sie dabei von einem „algorithmischen Boss“ kontrolliert. Die App zeichnet detaillierte Informationen über Fahrverhalten und Auftragszahlen auf. Die Dienstleistenden erhalten dann Vorschläge, wie sie ihr Verhalten gewinnbringend verändern können. Der Algorithmus wird zum Management-Tool.

Uber legt einseitig die Preise für Fahrten fest. Schlechte Bewertung im Rating-System oder das Ablehnen zu vieler Aufträge kann zum Jobverlust führen. Wollen Betroffene eine schlechte Bewertung beanstanden, müssen sie per E-Mail mit dem weit entfernten Kundendienst kommunizieren, der mit einer Reihe von Standardantworten reagiert.

Entgegen der Rhetorik des Silicon Valley seien Algorithmen, Daten und digitale Plattformen nicht neutral, urteilt Rosenblat. Uber präsentiert sich als Technologie- statt als Transportunternehmen. So umgeht es in den USA Arbeitnehmerrechte und Sozialversicherungsabgaben. Gleichzeitig steuert es das Verhalten der vermeintlich selbstständigen Dienstleistenden bis ins kleinste Detail und experimentiert ohne Ankündigung mit seiner Preispolitik.

Algorithmen können Diskriminierung Vorschub leisten. Ein Beispiel dafür ist laut der US-Forscherin und Künstlerin Caroline Sinders Gesichtserkennungssoftware. Dunkle Hautfarben erkennt das System schlecht, weil die Datensätze, mit denen Programmierer Algorithmen trainieren, nicht ausreichend divers sind. Wenn die Software dazu eingesetzt wird, an Grenzen darüber zu entscheiden, wer einreisen darf, kann das Nichterkennen zum Problem werden.

Einige Unternehmen verfolgten fragwürdige Absichten, meint Sinders. Das israelische Unternehmens Faception ordnet bestimmten Gesichtsmerkmalen Charaktereigenschaften zu und will damit potenzielle Terroristen erkennen. Rassismus scheint hier schon im Design angelegt.

Ein weiteres Problem ist laut Sinders, dass Nutzerinnen und Nutzer keinen Einfluss darauf haben, ob und wie Algorithmen auf sie wirken. Sie können nicht zustimmen, ablehnen oder Veränderungen erwirken. Sie haben kaum Rechte, das über sie gesammelte Datenmaterial löschen zu lassen.

Sinders fordert, die Menschenrechte müssten bei der Gestaltung von Produkten sorgfältig beachtet werden. Das erfordere vor allem Transparenz. Ein Produkt sollte so gestaltet sein, dass User es verstehen, Feedback geben und Veränderungen erwirken können.

Mehr Diversität in Entwicklungsteams führt zu besseren Ergebnissen. Innovation muss sich an den marginalisiertesten Gruppen orientieren und diese in den Prozess einbeziehen, meint US-Designerin und Forscherin Alexis Hope. Sie stellte auf der Republica ein Projekt vor, das in einem gemeinschaftlichen und inklusiven Prozess Ideen entwickelte, um Milchpumpen für Mütter von Kleinkindern zu verbessern.

Krise der Demokratie

Algorithmen bestimmen auch, welche Informationen Usern in Suchmaschinen und sozialen Medien angezeigt werden. Wer große Datensätze über sie hat, kann Algorithmen beispielsweise zur Wahlmanipulation einsetzen. Symbolisch dafür steht das Datenanalyseunternehmen Cambridge Analytica, das durch seine Rolle im US-Wahlkampf 2016 weltweit bekannt wurde.

Cambridge Analytica und seine Partnerfirmen waren auch in vielen Entwicklungsländern aktiv. Die dänisch-puerto-ricanische Forscherin Solana Larsen und die guatemaltekische Menschenrechtsanwältin Renata Avila kennen Beispiele aus Lateinamerika. Eine Firma identifizierte die ärmsten Bevölkerungsgruppen rund um Mexiko-Stadt und ließ sie Meinungsumfragen ausfüllen. Als Gegenleistung erhielten sie kostenlosen Internetzugang. Dass ihre Daten missbraucht werden könnten, war ihnen nicht klar. So können sogar Daten von Menschen, die gar nicht online sind, zur Wahlmanipulation genutzt werden.

In Kenia war Cambridge Analytica bereits seit 2011 aktiv und nahm Einfluss auf die Parlamentswahlen 2013 und 2017. Laut Nanjala Nyabola, Politologin und Aktivistin aus Kenia, erhielten viele Stimmbürger ihre Informationen aus sozialen Medien, wo gezielt Falschinformationen verbreitet wurden.

Durch den Einsatz von Wahlcomputern wurde die Wahl 2017 mit dem Gegenwert von 28 Dollar pro Kopf zur teuersten der Welt. Dennoch scheiterte der Versuch, durch Technologie mehr Transparenz und Glaubwürdigkeit herzustellen. Für Nyabola zeigt diese Erfahrung, dass technologische Lösungen kein Allheilmittel für politische und soziale Probleme sein können. Stattdessen brauche es eine aktive Bürgerschaft sowie Medien, die Regierungen zur Verantwortung ziehen.

Die strukturelle Ursache der Probleme liegt laut dem kanadischen Autor Cory Doctorow in der Monopolstellung der großen Technologieunternehmen. In manchen Ländern nutzen Menschen im Internet praktisch nur Facebook. Das steigert die Chancen zur Manipulation – nicht nur durch Facebook selbst, sondern auch durch Akteure, die diese Plattform geschickt nutzen. Weltweit greifen monatlich 2,3 Milliarden Menschen auf Facebook zu.

Die großen Internetplattformen haben laut Doctorow mittlerweile Monopole geschaffen und übernehmen immer mehr staatsähnliche Aufgaben. So werde von ihnen nun erwartet, dass sie Hassrede verhindern oder Urheberrechte durchsetzen. Die Machtkonzentration stellt für Doctorow eine Gefahr für die Demokratie dar. Für ihn liegt die Lösung im Aufbrechen der Monopole. Es sollte für Unternehmen schwerer sein, aufstrebende Wettbewerber aufzukaufen.

Monika Hellstern ist redaktionelle Mitarbeiterin von E+Z Entwicklung und Zusammenarbeit / D+C Development and Cooperation.

euz.editor@dandc.eu

Link

Republica Digitalkonferenz 2019:

https://19.re-publica.com/de